한 컷

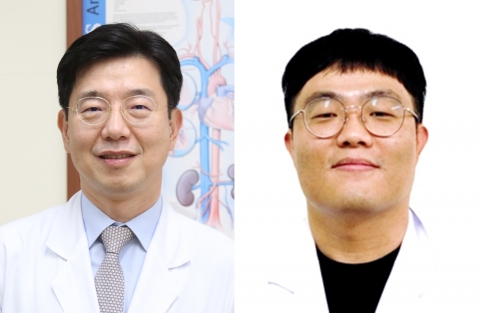

[한 컷]메디씽큐, 초미세수술 권위자 홍준표 교수 CMO로 합류

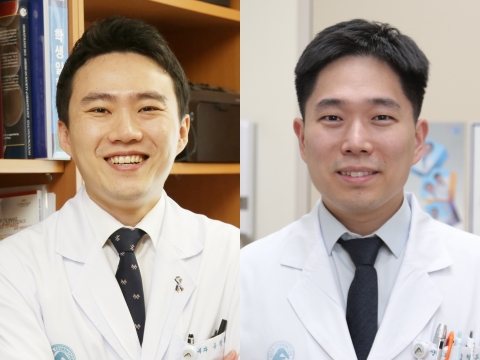

의료용 XR(확장현실) 웨어러블 디스플레이 솔루션 기업 메디씽큐(대표 임승준)는 세계적 초미세수술 권위자인 서울아산병원 성형외과 홍준표 교수가 최고 의학책임자(CMO)로 합류했다고 4일 밝혔다. 메디씽큐의 차세대 3D 디지털 미세수술 플랫폼 'SHIYA 20'의 임상적 가치를 수술·교육 현장에서 직접 검증해온 홍 교수의 합류로 기술 신뢰도가 한층 강화될 전망이다. 메디씽큐는 SHIYA 20을 앞세워 대만·싱가포르·말레이시아 독점 공급