AI 중국몽 차질···美 GPU 규제 탓병렬 방식 GPU···데이터 대량 처리데이터 처리량 급증···GPU 활용 ↑

한 매체가 챗GPT에 묻자 이 같은 대답이 돌아왔다. 여기서 GPU는 그래픽저장장치, TPU는 구글의 인공지능 전문 칩을 말한다. 챗GPT는 인공지능(AI) 챗봇 서비스인 만큼 전용 칩 탑재도 필요하나 GPU가 필요하다는 반응은 의외일 수 있다. 일반적으로 고사양 컴퓨터 게임에 활용되기 때문이다. 하지만 GPU는 중국 AI 산업을 견제하려는 미국의 수출규제 품목이며 AI 시장에 필수적으로 활용되는 반도체로 꼽힌다.

6일 홍콩 사우스차이나모닝포스트(SCMP)에 따르면 중국판 챗GPT는 미국의 반도체 수출규제로 기술발전이 지지부진하다. 글로벌 GPU 시장은 미국 기업인 엔비디아가 90%를 점유하고 있는데 미국이 지난해 8월 엔비디아 GPU인 A100·H100 등의 중국 판매를 금지하면서다. 이로 인해 AI 시장에 뛰어든 중국 알리바바와 텐센트, 바이두 등이 챗GPT와 같은 모델을 개발해내는 데 큰 도전에 직면했다고 SCMP는 전했다.

데이터센터용 GPU인 A100은 챗GPT 개발에 있어 1만여개 이상 탑재된 것으로 알려졌다. 상위 모델인 H100은 A100 대비 학습 속도가 9배 빠르고 대규모 언어 추론 속도는 30배 이상 빠른 대화형 AI를 제공하는 반도체다. H100은 작년 3분기 출시됐으나 업계에선 매출 규모가 이미 A100을 넘어선 것으로 파악하고 있다.

엔비디아는 챗GPT 효과를 입은 대표적인 기업으로 꼽힌다. 챗GPT가 공개된 지난해 12월1일 주가는 171.35달러에 그쳤으나 3월3일에는 238.90달러까지 올랐다. 지난달 22일(현지시간)에는 작년 4분기 매출이 21% 감소했다는 소식에도 23일 주가는 오히려 14% 급등했다. 젠슨 황 엔비디아 최고경영자(CEO)는 실적을 발표하면서 "AI는 변곡점에 있으며 모든 산업에 광범위하게 도입될 준비를 하고 있다"고 말했다.

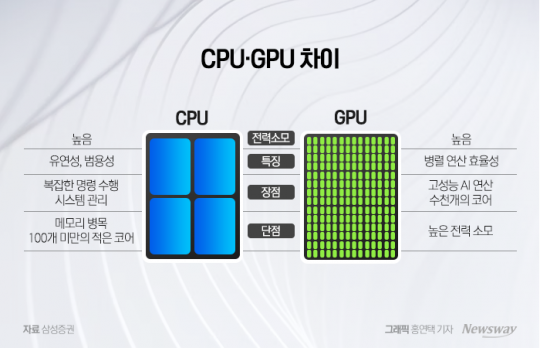

반도체가 탑재되는 제품의 성능은 대게 AP(애플리케이션프로세서)와 CPU(중앙처리장치) 성능이 좌우하나 AI 시장에선 GPU의 중요성이 크다. GPU는 CPU와 달리 코어 수가 무수히 많은 데 반도체는 코어가 많을수록 속도가 빠르고 동시에 더 많은 작업이 가능해지기 때문이다.

또 CPU의 연산처리방식은 명령어를 순서대로 처리하는 '직렬'이지만 GPU는 여러 명령어를 동시에 처리하는 '병렬'이다. AI는 복잡한 계산보다 반복적인 학습이 많아야 해 데이터를 한 번에 대량으로 처리하는 GPU 수요가 높아질 수밖에 없는 것이다. 김양팽 산업연구원 전문연구원은 "GPU는 그래픽을 병렬 처리 방식으로 처리하는데 이는 AI 연산에도 활용될 수 있다"고 말했다.

챗GPT는 기술발전에 따라 처리해야 하는 데이터양이 증가하고 있어 GPU의 활용도는 앞으로도 커질 전망이다. 2018년 챗GPT 초기모델인 GPT-1의 파라미터(매개변수)는 1억1700만개에 그쳤으나 2020년에 등장한 GPT-3는 1750억개로 2년 만에 1000배 이상 늘었다. 파라미터는 인간의 뇌로 비유하면 신경세포(뉴런)끼리 정보를 전달하는 통로인 '시냅스'에 해당해 AI의 인공신경망 역할을 한다.

김재은 NH투자증권 연구원은 "초거대 AI는 인공신경망 파라미터 개수를 수천억 개에서 수조 개까지 늘리고 있다"며 "이는 파라미터 개수가 많을수록 AI가 데이터를 분석하는 능력도 우수해지기 때문"이라고 설명했다. 그러면서 "후속모델인 GPT-4 개발에는 2만5000개의 GPU가 활용된 것으로 추정된다"고 분석했다.

관련기사

뉴스웨이 김현호 기자

jojolove7817@newsway.co.kr

저작권자 © 온라인 경제미디어 뉴스웨이 · 무단 전재 및 재배포 금지

댓글